Компании нужен благонадежный и ответственный сотрудник на важную должность. Отдел кадров заносит список кандидатов в компьютер, по этому списку претендентов в автоматическом режиме обзванивает бот, задает определенный набор вопросов, после чего система по тембру голоса определяет, пытался ли собеседник что-то приукрасить в рассказе о себе, есть ли у него склонность к обману или это исполнительный, вдумчивый, настойчивый человек. Примерно так работает новый ИТ-сервис российской компании F2FGroup, который был недавно представлен в Москве.

Среднестатистический человек врет три раза за десять минут разговора. Это декларирует герой популярного американского сериала «Обмани меня» (Lie to me) доктор Лайтман, который придумал способ определять, лжет человек или нет, путем отслеживания мельчайших признаков эмоций на лице или в движениях. Лайтману достаточно внимательно смотреть на собеседника во время разговора, чтобы понять, что, например, на микросекунду сведенные брови свидетельствуют о страхе, а случайно опущенный взгляд — о стыде. Пользуясь этим приемом, Лайтман успешно находит убийц, распутывает заговоры нечестных чиновников и бизнесменов, предотвращает террористические акты.

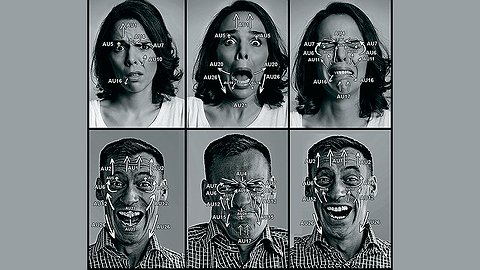

Прототипом героя сериала стал известный американский ученый-психолог профессор Калифорнийского университета Пол Экман, которого журнал Time включил в топ-100 самых влиятельных людей мира за создание теории распознавания лжи. Ученый начал исследовать человеческую мимику еще в начале 1950-х и пришел к выводу, что так же, как в музыке есть семь нот, у человека существуют семь базовых эмоций: гнев, печаль, презрение, отвращение, страх, удивление, радость, которые в чистом или смешанном виде проявляются на лице в виде так называемых микровыражений. Это короткие (не более четверти секунды) непроизвольные выражения лица, появляющиеся у человека, который пытается скрыть или подавить эмоцию. Именно по микровыражениям, считает Экман, можно понять, какую эмоцию в действительности испытывает в данный момент человек: ее нельзя подделать или контролировать, она возникает и проявляется неосознанно.

Откровенный разговор

Созданную на основе работ Пола Экмана так называемую систему кодирования выражений лица FACS (Facial Action Coding System) широко используют во всем мире. В России эту теорию развивают, в частности, на кафедре психологии личности факультета психологии МГУ. Профессор этой кафедры Алексей Гусев стал одним из основателей компании F2FGroup, которая поставила перед собой задачу «оцифровать» человеческие эмоции и разработать алгоритм, который распознавал бы истинные эмоции человека во время разговора. Пока в компании решили сделать упор на анализ голоса.

«Голос в нашем речевом аппарате — это отражение деятельности голосовых мышц, — говорит Алексей Гусев. — Активность мышц, в свою очередь, регулируется человеческим мозгом. Получив некий эмоциональный стимул, мозг заставляет мышцы напрячься или сократиться, именно поэтому появление эмоции отражается на интонации. Если во время диалога человек вспоминает нечто неприятное для него, его голос становится более напряженным, а позитивные эмоции вызывают своеобразный подъем, прилив энергии. Эти изменения мы и научились фиксировать и интерпретировать с помощью нашего решения».

Новый ИТ-продукт компании F2FGroup — онлайн-платформа 151EYE, которая позиционируется как интеллектуальная система для оценки компетенций и благонадежности кадров по голосу с точностью распознавания 96%.

Сервис работает следующим образом. Клиент (компания, которая подбирает персонал) регистрируется на специальном сайте и загружает туда список кандидатов. Далее в зависимости от задачи выбирается тип тестирования. Например, это может быть тест с упором на компетенции, когда работодателю особенно важно понять, какими навыками обладает кандидат в профессиональной сфере, какие должностные обязанности у него были на прежних местах работы, что ему удавалось, а что нет. Или можно выбрать так называемый риск-тест, когда заказчику в первую очередь важно понять уровень ответственности и честности кандидата. Здесь бот может задавать провокационные вопросы вроде «как вы относитесь к кражам на рабочем месте?», «брали ли вы без спроса деньги или ценное оборудования за последний год?», «слышали ли вы о подобных происшествиях со своими коллегами?».

Ответы респондента анализируются компьютерной системой по 151 параметру — точнее, анализируется не то, что он говорит, а как он это делает. По словам Бориса Фрола, руководителя ИТ-проектов F2FGroup, алгоритм анализирует микроизменения голоса на временных промежутках длиной три–пять миллисекунд, выделяя периоды низко- и высокочастотных колебаний. Далее алгоритм анализирует эти данные и выдает уровень рисков и компетенций для каждого вопроса. Например, машина может определить, что голос респондента был излишне взволнованным, когда он отвечал на вопрос о кражах, или, наоборот, очень твердым и уверенным, когда его спрашивали про обязанности на работе. Или, например, в голосе зафиксирован так называемый коэффициент дрожания, что система относит к «проявлению смущения или внутренним конфликтам».

«Голос во время разговора не может отличаться тональными скачками или, наоборот, быть слишком монотонным, — все это говорит о наличии особых эмоций. Частота основного тона голоса характеризует уровень концентрации говорящего на теме. Скажем, однообразность частного спектра — это дополнительный показатель лжи, а количество пиков тональностей отражает уровень эмоционального стресса», — объясняет Алексей Гусев.

На основе этих принципов компьютер делает вывод об истинных компетенциях и качествах собеседника, окрашивая результаты ответов в разные цвета: если все вопросы по результатам собеседования отмечены зеленым цветом, то потенциальный сотрудник предварительно считается подходящим на должность. Желтый цвет говорит о том, что кандидат не полностью соответствует требованиям рекрутера, красный цвет показывает, что у человека есть большие проблемы с честностью при ответах на поставленные вопросы.

Вывести на чистую воду

Представители F2FGroup заявляют, что их разработки уникальны в своем роде в России и в мире. Есть ряд стран, которые тоже развивают технологии анализа голоса (так называемые системы LVA), с ними российская компания сотрудничает — в частности, речь идет об израильской Nemesysco. Пока онлайн-платформа F2FGroup анализирует только голос собеседника, но в ближайшем будущем предполагается внедрять и анализ видеоизображения, где по схожему с анализом голоса алгоритму будет проводиться аналитическая оценка мимики человека.

Стоимость голосового анализа для одного сотрудника с помощью алгоритмов системы F2FGroup начинается с одной тысячи рублей. Это, по словам представителей компании, довольно низкая цена, так как на рынке стоимость услуг проверки честности, скажем на таком распространенном детекторе лжи, как полиграф, начинается с четырех тысяч рублей за человека и может достигать 15 тысяч рублей.

Согласно оценкам Международной ассоциации кадровых компаний (APSCo), мировой рынок услуг по подбору персонала сейчас оценивается в 490 млрд долларов и продолжает динамично расти. По словам представителей F2FGroup, их технологией уже начинают пользоваться компании из разных отраслей. Например, выступивший на презентации Сергей Лошкарев, представитель российской авиакомпании Smartavia, заявил, что с помощью нового сервиса их компания осуществляла тестирование 350 бортпроводников, и результаты этой работы существенно помогли им в оценке личностных качеств персонала.

В F2FGroup говорят, что в будущем видят большие перспективы применения своего решения в самых разных отраслях: помимо набора кадров это может быть, например, транспортная безопасность (когда по мимике или жестам можно отличать потенциальных преступников или мошенников), оценка рисков для кредитных организаций или страховых компаний, а также работа в сфере криминалистики.

В F2FGroup рассказывают, что к ним все чаще обращаются представители российских силовых структур с целью «вывести на чистую воду» закоренелых преступников, поняв, в каких случаях те пытаются обмануть следствие. Приходят в компанию и представители служб безопасности крупных коммерческих структур. Например, недавно в одном крупном банке нужно было выяснить, кто из персонала был виновен в утечке базы данных клиентов. После собеседования система выявила большой риск обмана у одного из системных администраторов. Позже предположения подтвердились: подозреваемый оказался наркозависимым и признался, что продал корпоративную базу данных конкурентам.